Inteligencia Artificial: oportunidades y desafíos en clave canaria

Cuando Yaiza, vecina de Las Palmas, recibe una notificación de Netflix recomendándole la nueva temporada del hit coreano El Juego del Calamar, no sabe que para ello un algoritmo de IA analizó sus gustos basándose en parámetros que ni ella misma sabría responder.

Tampoco nota que el chatbot que usó ayer para reclamar un equipaje perdido a Binter funciona con tecnología similar. La inteligencia artificial ya está integrada en las vidas de los canarios; desde los sistemas de riego en plataneras de La Palma hasta los precios dinámicos de apartamentos turísticos en Maspalomas. Me planteo explicarles cómo herramientas como la china DeepSeek –y sus limitaciones– seguirán cambiando empleos, afectan ya a las facturas de la luz y hasta la conservación de nuestros espacios naturales.

¿Cómo funciona una IA?

Imagina que le enseñas a un niño a distinguir papas arrugadas de boniatos a base de mostrarle 10.000 fotos de cada una. Al final, reconocerá los patrones: rugosidad, color, tamaño. Así funciona un modelo de IA, pero a escala monstruosa. DeepSeek, por ejemplo, se entrenó con millones de libros, artículos y conversaciones de internet hasta octubre de 2023.

Es como un GPS que solo conoce cómo estaban las carreteras hasta octubre de 2023. Por lo tanto es muy útil para rutas generales, pero no para esquivar un corte actual en la GC-1.

Voy a dejar que sea el propio DeepSeek quien nos explique los distintos tipos de IA y cómo funcionan. Solo haz click aquí.

¿Qué puede (y no puede) hacer DeepSeek?

En un panorama donde las herramientas de IA se han convertido en extensiones del conocimiento humano, los chatbots se posicionan como un recurso versátil para la educación, la creatividad y la resolución de problemas. Sin embargo, como toda tecnología emergente, su alcance está definido tanto por sus habilidades como por sus restricciones técnicas y éticas.

Capacidades: un puente hacia el conocimiento

DeepSeek funciona como un interlocutor capaz de desglosar temas complejos, desde los mecanismos del cambio climático hasta los principios de la teoría de la relatividad, con un lenguaje accesible. Su repertorio abarca disciplinas como la ciencia, la filosofía, la tecnología y la cultura, lo que la hace útil tanto para estudiantes que buscan claridad como para profesionales que necesitan síntesis rápidas. Además de explicar conceptos, puede asistir en tareas de investigación: organizar ideas, resumir artículos académicos y sugerir fuentes de consulta, aunque con la advertencia de que no navega en internet para validar datos en tiempo real.

El multilingüismo es otra de sus fortalezas. Opera en español, inglés, francés y alemán, entre otros idiomas, aunque sus respuestas más depuradas se encuentran en inglés y español, según reconocen sus creadores. Esta flexibilidad lingüística se combina con una creatividad práctica: desde redactar poemas o correos formales hasta generar ideas para nombres de empresas o estrategias de marketing, la herramienta actúa como un colaborador polivalente.

Para desafíos técnicos, DeepSeek ofrece apoyo en matemáticas, lógica o programación, explicando algoritmos o ayudando a depurar códigos. Incluso sugiere recomendaciones personalizadas, como libros o películas, adaptadas a los intereses del usuario, o diseña rutinas de estudio que prometen optimizar el aprendizaje.

Limitaciones: la otra cara de la moneda

A pesar de su versatilidad, la IA de origen chino no es ni de lejos infalible (ninguna lo es). En el caso de DeepSeek, su conocimiento está congelado en el tiempo: solo procesa información disponible hasta octubre de 2023, lo que la deja fuera de eventos recientes, avances científicos posteriores o cambios sociopolíticos actuales. Este límite se debe a que su entrenamiento dependió de humanos que clasificaron y etiquetaron datos hasta esa fecha, un proceso riguroso pero que sacrifica actualidad por precisión.

Otro desafío es su desconexión de la web. Al no acceder a internet, no puede verificar noticias, consultar bases de datos actualizadas o recuperar enlaces funcionales. Si un usuario le pide fuentes, es probable que cite documentos obsoletos o hipervínculos rotos, una brecha que puede frustrar a investigadores que necesitan referencias recientes.

La precisión, aunque prioritaria, no es uniforme. En temas altamente especializados —como normativas legales cambiantes o avances médicos—, sus respuestas pueden contener errores o información desactualizada. Los desarrolladores advierten de que, en estos casos, siempre debe contrastarse la información con fuentes oficiales.

La ética, por otro lado, marca una frontera clara. La IA se niega a abordar temas ilegales, subjetivos o que violen la privacidad, evitando generar contenido discriminatorio o especular sobre dilemas morales delicados. Un claro ejemplo de ello es que se niega a responder preguntas acerca de las protestas en la plaza de Tiananmen en 1989, un tema “peliagudo” para el Gobierno chino.

Finalmente, en conversaciones extensas, su contexto puede desvanecerse si el usuario no repite detalles clave, lo que exige una comunicación clara y reiterada para mantener la coherencia.

Una inteligencia artificial, por muy avanzada que sea, no puede reemplazar el criterio humano, sino complementarlo. Es útil para despejar dudas rápidas, inspirar proyectos o estructurar ideas, pero su uso responsable implica reconocer sus límites: no es un oráculo, sino un recurso sujeto a errores y desfases temporales. En un mundo inundado de información, su valor radica en cómo los usuarios integran —y cuestionan— sus respuestas. La tecnología avanza, pero la necesidad de pensamiento crítico, como advierten tantos expertos, sigue siendo la brújula indispensable.

La IA no es buena ni mala: es un espejo de las decisiones humanas

Desde la invención de la máquina de vapor hasta la energía nuclear, la historia está plagada de tecnologías que desataron debates morales. La inteligencia artificial, protagonista de la revolución digital del siglo XXI, no es ninguna excepción. Pero como ocurrió con el ferrocarril, la electricidad o el mismo internet, la pregunta no radica en si es “buena” o “mala”, sino en cómo se desarrolla, quién la controla y qué sacrificios implica su desarrollo para las sociedades y el medioambiente.

Expertos en ética tecnológica y científicos coinciden: el verdadero dilema de la IA no está en su naturaleza, sino en las prioridades que guían su avance. Mientras empresas y gobiernos compiten por dominar algoritmos más veloces y sistemas autónomos, surgen dudas sobre los costes ocultos de esta carrera. ¿Se prioriza la eficiencia sobre la privacidad? ¿Se mide el impacto ambiental de los centros de datos que consumen energía equivalente a países enteros? ¿O se diseña con transparencia para evitar sesgos que perpetúen desigualdades?

El precio del progreso

Un informe de la Universidad de Massachusetts reveló en 2019 que entrenar un modelo avanzado de IA puede emitir hasta 284 toneladas de CO₂, cinco veces más que un automóvil promedio en toda su vida útil. Este dato ejemplifica una paradoja: herramientas creadas para optimizar recursos podrían acelerar la crisis climática si su desarrollo ignora la huella ecológica. Además, la extracción de minerales como el litio o el cobalto, esenciales para los servidores que alimentan la IA, está vinculada a la degradación de ecosistemas y a la explotación laboral en países del sur global.

Pero con la irrupción de DeepSeek en el mercado, muchos se están preguntando por qué Silicon Valley quiere 500.000 millones del gobierno de Trump para desarrollar sus modelos, además de los miles de millones invertidos hasta ahora por el sector privado, cuando DeepSeek ha salido de una inversión de “apenas” 5,5 millones de euros; calderilla en comparación.

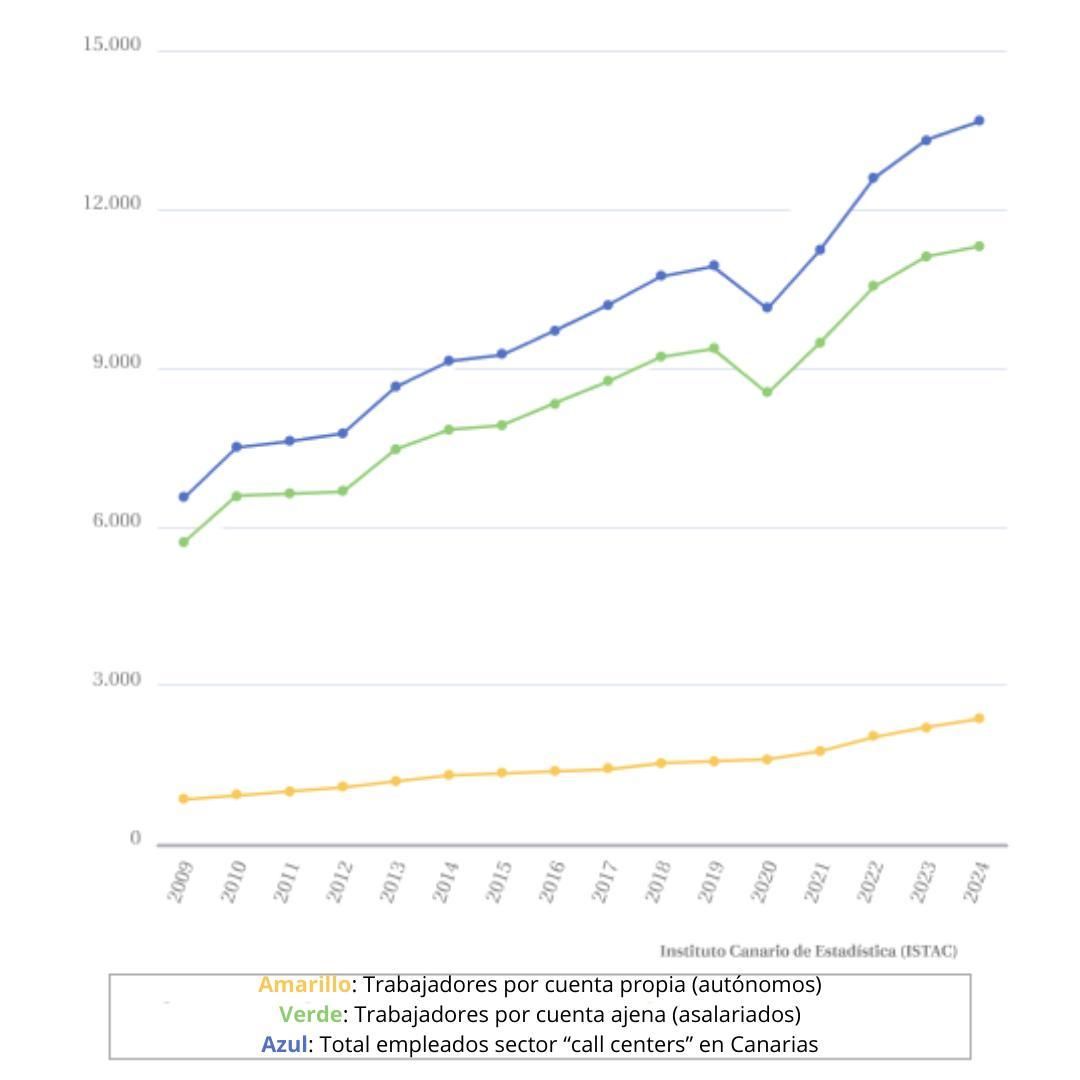

Pero los costes no son sólo ambientales. La automatización de trabajos, desde conductores hasta analistas financieros, amenaza con desplazar a millones de personas, mientras gigantes tecnológicos acumulan un poder sin precedentes. Hablamos de algoritmos que deciden créditos bancarios, diagnósticos médicos o condenas judiciales.

¿Innovación con rumbo?

El avance de la IA también plantea dilemas filosóficos. Proyectos como los chatbots de última generación (como es DeepSeek) o los sistemas de reconocimiento facial se desarrollan a velocidades que han superado con creces la capacidad de regulación de los gobiernos. China, la Unión Europea y los Estados Unidos libran ahora una batalla comercial por la supremacía en este campo, pero con visiones opuestas: vigilancia masiva versus protecciones ciudadanas, código abierto versus patentes restrictivas.

Mientras tanto, colectivos como Algorithmic Justice League denuncian que los sesgos en los datos de entrenamiento refuerzan el racismo y la discriminación de género. Un caso emblemático ocurrió en 2018, cuando Amazon desmanteló un sistema de contratación que penalizaba currículos con la palabra “mujer”. La IA no era “machista”, pero replicaba prejuicios históricos presentes en la información con la que se alimentó.

Para organizaciones como la UNESCO, el camino no pasa por detener la IA, sino por orientarla hacia metas colectivas. En 2021, 193 países adoptaron la primera Recomendación sobre la Ética de la IA, un marco que pide transparencia, sostenibilidad y respeto a los derechos humanos. En 2024, el Consejo de Europa aprobaba el primer tratado internacional sobre inteligencia artificial, que al contrario que el documento anterior si es vinculante jurídicamente.

La IA es una herramienta, nada más. Su impacto depende de si la usamos para vigilar poblaciones o para predecir sequías, para manipular mercados o para democratizar el acceso a la educación. La historia sugiere que aunque las tecnologías en sí mismas son neutrales, en la práctica sus consecuencias no lo son: reflejan los valores de quienes las controlan. Por eso, el debate no debería ser sobre si la IA es benévola o peligrosa, sino sobre qué clase de mundo queremos construir con ella.

El impacto de la IA en la vida cotidiana de los canarios

La IA no es magia (pero sí una herramienta con consecuencias)

Cuando Aday, restaurador de La Restinga, usa una app de IA para traducir “mero a la sal” al alemán para su menú, no necesita entender redes neuronales. Sólo que eso atraerá a más turistas a su restaurante.

La clave está en usarla – y regularla – como cualquier otra herramienta: bien empleada, construye oportunidades; mal usada, destruye empleos.

El futuro no lo encontraremos en temerla o divinizarla, sino en exigir que las normas protejan a las personas y sus necesidades primero, en lugar de usarla únicamente para reducir costes para las empresas a costa de los intereses de la ciudadanía.

Pero, ¿qué dice la propia DeepSeek acerca del futuro de las inteligencias artificiales? Aproveché bien la gratuidad de la aplicación, realizando múltiples tests para comprobar sus capacidades reales para este reportaje. Finalmente, le pregunté: “¿Dónde crees que se dirige el futuro de la IA? Busco predicciones concretas, realistas, justificando tus respuestas y sin maquillar las palabras”.

Y esto es lo que respondió.

0