¿Salvar al anciano o al niño? Una ‘máquina de la moral’ podría ayudar al coche autónomo a decidir

La implantación del coche plenamente autónomo se da como un hecho cierto en la industria del automóvil, hasta el punto de que solo se discute en qué fecha será una realidad. Respondida la pregunta capital (sí, habrá vehículos que circulen solos), el resto de las cuestiones relacionadas con el asunto genera una extensa lista de incertidumbres que afectan tanto al derecho y al mundo de los seguros como a la ética, en especial cuando un coche con nivel 5 de automatización, el máximo, tenga que enfrentarse al dilema de a quién dañar, y a quién no, en caso de un accidente inevitable que plantee semejante disyuntiva.

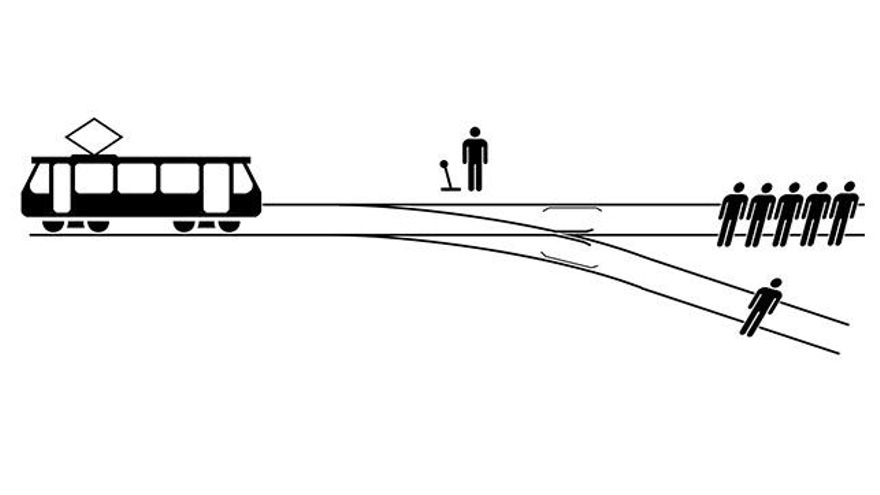

En el clásico dilema del tranvía, se pone sobre el tapete la siguiente encrucijada: si un tren se acerca a una vía en la que están atadas cinco personas y a otra donde hay atada una sola persona, ¿qué debe hacer: salvar a cinco y sacrificar a uno? Parece que el principio del mal menor debería imponerse en este caso, pero seguramente seríamos incapaces de ponernos de acuerdo en elecciones menos claras y, siendo sinceros, cuando entran en conflicto nacionalidades, razas, edades y otras consideraciones particulares.

Para complicarlo todo aún más, la cultura también desempeña un papel destacado en esta cuestión, porque si para un occidental la vida de un niño tal vez tendría más valor que la de un anciano, y por tanto merecería ser privilegiada en una situación desesperada, es posible que un africano pensara lo contrario y prefiriera salvar a la persona de edad, por la sabiduría que atesora y el respeto que merece según un criterio mayoritariamente extendido en muchas sociedades de su continente.

Rara vez, por no decir nunca, se ha enfrentado la industria a un debate moral de este calado. De hecho, excede con mucho el ámbito de un sector concreto, razón por la que seguramente ha querido involucrarse en la cuestión el prestigioso Massachusetts Institute of Technology (MIT) al poner en marcha una plataforma, con la que pretende crear una suerte de Moral Machine (una “máquina moral”) válida para los vehículos autónomos.

Gracias a ella, los coches del futuro podrían, idealmente, tomar una serie de decisiones reservadas hasta ahora el género humano, eso suponiendo que las personas inmersas en una tesitura como la que acabamos de describir sean capaces de decidir algo y no se limiten a cerrar los ojos ante lo que se les presenta como ineludible.

Moral Machine es un experimento del grupo Scalable Cooperation del MIT en el que están involucrados dos grandes fenómenos de nuestro tiempo, el big data y la inteligencia artificial. Todo comienza con la recolección de datos. La plataforma propone diferentes situaciones críticas donde los usuarios deben escoger qué acción debería ejecutar la máquina (un tren o un automóvil) en un escenario que implica un riesgo para quien está dentro de ella o para personas que se ven envueltas en el problema sin tener en principio relación con él.

Con base en ese inmenso caudal de información se podría desarrollar una especie de ética general, una moral universal que se implementara en dispositivos que impliquen el uso de inteligencia artificial, como los automóviles autónomos. El éxito de la herramienta reside en la participación pública, es decir, en obtener una recopilación de datos de tal magnitud que permita construir una imagen universal, por medio del crowdsourcing (o colaboración abierta), de la opinión de los humanos sobre cómo deben conducirse las máquinas cuando se enfrentan a dilemas morales.

Creencias religiosas, convicciones, arquetipos sociales y otros criterios subjetivos intervendrán en la confección de esta suerte de consenso global sobre lo socialmente aceptable. El objetivo no solo se antoja imposible de conseguir, sino que presenta innumerables incógnitas legales y anuncia una revolución en el campo de los seguros de coches.

Por ceñirnos a la ética, una primera oleada del experimento, que recogía la opinión de dos millones de participantes, arrojaba tres conclusiones principales: por lo general, damos prioridad a salvar al mayor número de personas posible; a elegir a los niños frente a personas mayores, y a preferir a humanos antes que a animales (esta es otra: ¿qué diría un animalista a ultranza?).

La investigación, publicada en Nature, indicaba que, de los viandantes que cruzan por un paso de cebra, quienes merece la pena salvar de ser atropellados son, por este orden: un bebé a bordo de un carrito, una niña, un niño y una mujer embarazada. En el lado opuesto (mascotas aparte), delincuentes, ancianos y personas sin hogar serían las personas más sacrificables, esas que en Colombia se conocen –tan coloquial como brutalmente– como desechables.

Naturalmente, bastaba rastrear los 233 países y territorios desde los que se había participado en el experimento para sentenciar la parcialidad de las respuestas. Los países del sur tendían a salvar más a las mujeres que a los hombres. En las naciones más desiguales, los participantes preferían salvar al peatón con aspecto de ejecutivo… Ninguno de estos criterios parece mejorar el que imponen el azar, la fatalidad o el error humano en los accidentes tal como suceden hoy.