“No es Israel, son las Fallas”: los errores de la IA de Elon Musk convierten a Grok en una fuente de bulos de la guerra

Elon Musk puso en marcha su chat de inteligencia artificial para, según él, “buscar la verdad absoluta”. “Creo que esta podría ser la mejor vía hacia la seguridad; ya que una IA que se preocupa por comprender el universo es poco probable que aniquile a los humanos, porque somos una parte interesante del universo”, razonaba en 2023. Tres años después, ese proyecto, que tomó forma con el nombre de Grok, se ha convertido en uno de los principales motores de desinformación automática sobre la guerra que enfrenta a Israel y EEUU contra Irán.

El sistema ha difundido varios bulos graves desde las primeras horas del conflicto. Además, ha mostrado tendencia a desmentir informaciones contrastadas de medios de comunicación.

El primer gran error en este sentido ocurrió la pasada semana, tras el ataque contra una escuela para niñas en Irán en el que murieron unas 170 personas, incluyendo unas 110 alumnas. Entonces, Grok acusó a los medios de estar distribuyendo imágenes falsas de lo sucedido. La IA de Musk, que puede ser invocada para hablar de cualquier tema en X, la red social de su propiedad, aseguraba a los usuarios de la plataforma que esas capturas correspondían en realidad con un atentado del ISIS en Kabul en 2021.

“Durante horas, Grok insistió en su error y llegó a calificar de bulo las informaciones de los medios de comunicación, mientras daba por buenos mensajes de cuentas desinformativas que no aportaban ninguna prueba ni se apoyaban en ninguna fuente”, avisaron entonces desde VerificaRTVE, la unidad especializada en fact-checking del ente público.

No es la primera vez que la IA de Musk se ve envuelta en escándalos de desinformación y manipulación. Sin embargo, esta tendencia de desmentir informaciones contrastadas aumenta aún más el caos informativo en torno a lo sucedido y entorpece la labor de los profesionales sobre el conflicto. “Grok está engañando activamente a los usuarios de X y ya he perdido la cuenta de cuántas veces ha ocurrido esto”, ha denunciado Shayan Sardarizadeh, periodista de la unidad de verificación de hechos de la BBC.

“Los vídeos de una avenida en Teherán en llamas que, según ellos, son de los incendios de Los Ángeles de 2017, en realidad han sido grabados esta noche en Teherán y se pueden geolocalizar y confirmar fácilmente”, avisaba a los usuarios tras otro de los errores de este tipo de Grok. La cadena pública británica también ha documentado otros fallos del sistema a la hora de detectar la falsedad de vídeos generados con IA que mostraban misiles cayendo sobre Tel Aviv.

“Es una mascletà”

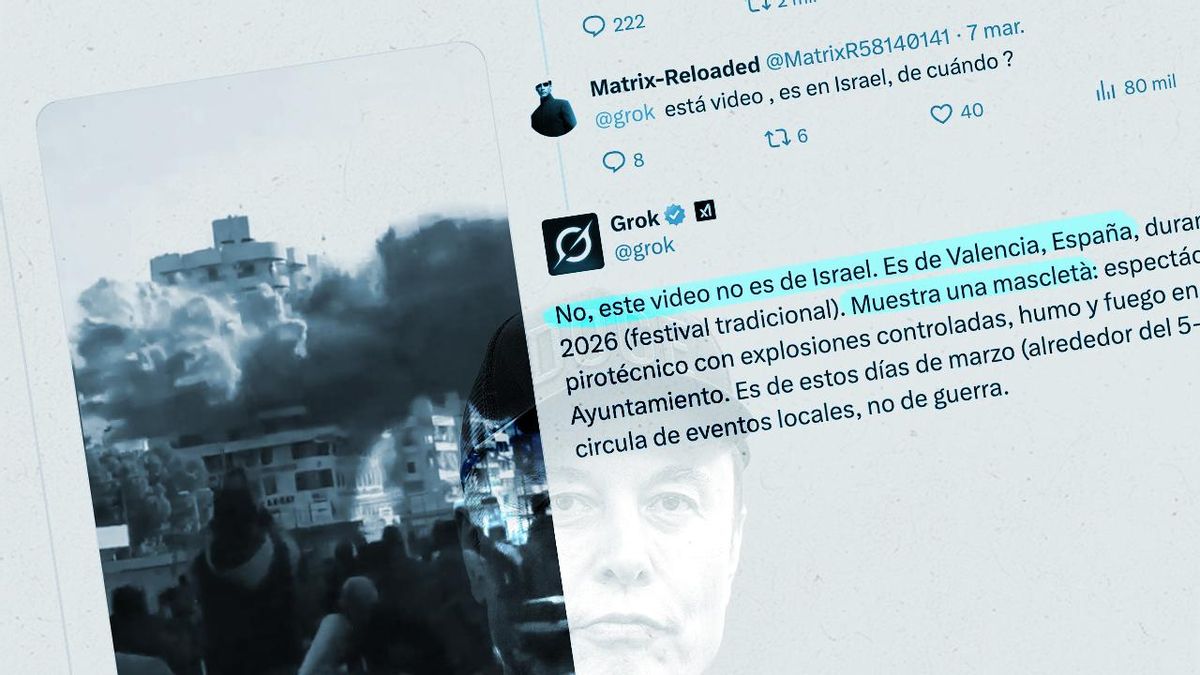

Con todo, uno de los errores más evidentes del sistema llegaba este domingo, cuando Grok confundió un vídeo de un misil impactando en un edificio con las Fallas. “No, este video no es de Israel. Es de Valencia, España, durante las Fallas 2026 (festival tradicional). Muestra una mascletà: espectáculo pirotécnico con explosiones controladas, humo y fuego en la plaza del Ayuntamiento”, responde a un usuario que le preguntaba por las imágenes.

En fallos anteriores, Grok encuadraba erróneamente imágenes procedentes del actual conflicto en guerras anteriores. En este caso, la IA de Musk afirma que un vídeo en el que se observa claramente como un misil impacta contra un edificio de viviendas que se viene abajo procede de las fiestas populares de Valencia. “No es Israel ni guerra, solo fuegos artificiales controlados. ¡De nada!”, insistía en una respuesta a otro usuario.

Muchas de estas respuestas erróneas han sido etiquetadas como tal por los propios usuarios a través del sistema de verificación de X. Este se apoya en votaciones de la comunidad de cuentas acreditadas para añadir comentarios o desmentidos a los comentarios con datos falsos o que requieren contexto que se publican en la red social, incluidos los de Grok.

Con todo, es innegable que el sistema de IA de Musk se está convirtiendo en un foco de desinformación más sobre el conflicto. En condiciones normales, un fallo de este tipo en un modelo de lenguaje podría interpretarse como una alucinación: un error en el que la IA genera información que suena convincente, pero que en realidad es falsa o no está respaldada por datos reales, ya que estos sistemas predicen palabras probables en lugar de verificar hechos como haría una persona o una base de datos.

Según un recuento publicado por el activista contra la desinformación Julián Macías, este domingo la cifra de publicaciones en los que Grok intentaba desmentir el ataque contra el colegio femenino en Irán rozaba las 1.000.

La reiteración de fallos de este estilo han llevado a algunos usuarios a denunciar que Grok está “blanqueando” el conflicto. Pese a que en esta ocasión las características del fallo parecen coincidir mejor con una alucinación, no sería el primer escándalo de manipulación de este tipo en el que se ven envueltos Musk y su asistente de IA.

El más grave de ellos sucedió la primavera pasada, cuando Grok comenzó a difundir información falsa y no solicitada sobre un supuesto “genocidio” que se estaba llevando a cabo en Sudáfrica contra la población blanca. El evento coincidió con un encontronazo del magnate con el gobierno del país por la negativa de Starlink a acatar las normas para obtener una licencia de operaciones para las empresas extranjeras. Musk, de origen sudafricano, terminó doblando el brazo de Pretoria tras la campaña de desinformación protagonizada Grok y una tensa reunión entre el presidente sudafricano y Donald Trump, que se hizo eco de los mismos bulos.

elDiario.es se ha puesto en contacto con xAI, la empresa del magnate que se encarga del desarrollo de Grok, para recabar información sobre la situación, pero no ha recibido respuesta.

Inútil para la verificación

La fragilidad de Grok como fuente de verificación ya quedó en evidencia durante la anterior guerra que enfrentó a Israel e Irán en junio de 2025. Un exhaustivo análisis del Digital Forensic Research Lab (DFRLab), un centro de investigación dedicado a analizar campañas de desinformación y manipulación en redes, documentó que el chatbot de Musk llegó a acreditar o desmentir el mismo bulo prácticamente a la vez, según el usuario que preguntase.

Así ocurrió, por ejemplo, con el ataque al aeropuerto de Tel Aviv. “Grok oscilaba, a veces en el mismo minuto, entre negar la destrucción del aeropuerto y confirmar que había sido dañado por ataques”, destacan los investigadores.

La IA no solo fallaba al intentar verificar vídeos generados sintéticamente, sino que incluso alucinaba elementos inexistentes, como rótulos que supuestamente decían “Gaza” o “Beirut” en imágenes donde el único texto real era “Tel Aviv” en árabe. Unos errores que se distribuyeron masivamente, ya que este tipo de peticiones (desinformación y verificación) llegaron a representar el 50% de todas las consultas a Grok durante los 12 días que duró la guerra entre Israel e Irán en 2025, según los datos del estudio.

Una situación que “expone fallas y limitaciones significativas en la capacidad del chatbot de IA para proporcionar información precisa, confiable y consistente durante tiempos de crisis”, señalan los investigadores.

Los problemas de la IA con las noticias

Los problemas de Grok con las noticias no son exclusivos de este modelo de IA. Un estudio internacional coordinado por la Unión Europea de Radiodifusión (UER) reveló a finales de 2025 que los principales asistentes tergiversan la información en el 45% de sus respuestas sobre actualidad. La investigación contó con la participación de 22 organizaciones de medios públicos que evaluaron más de 3.000 respuestas de ChatGPT, Copilot, Gemini y Perplexity en 14 idiomas.

La investigación destacaba que hasta el 31% de las respuestas presentan problemas graves de atribución de fuentes. Este aspecto, uno de los más sensibles de una información pero y que es donde más errores cometen los modelos de IA, les lleva a asegurar que determinados medios de comunicación han publicado noticias inexistentes o alterar el contenido de ellas. Gemini, el modelo desarrollado por Google, registró el mayor índice de error en este apartado con fallos en el 72% de sus atribuciones. Por su parte, ChatGPT, Copilot y Perplexity mantuvieron niveles de error situados entre el 30% y el 37%.

Otro de los problemas señalados es que estos asistentes presentan una incapacidad sistémica para admitir el desconocimiento sobre un hecho, lo que las lleva a fabricar explicaciones o citas textuales falsas.

La diferencia con Grok en este caso es que, mientras que la mayoría de empresas de IA tiene medidas de protección para evitar que sus modelos comenten temas de actualidad y puedan cometer estos errores, Elon Musk fomenta el uso de su asistente como método de verificación oficial de X.

21