El 96% de los 'deepfakes' que hay en Internet son de pornografía no consentida

Caras en cuerpos de otras mujeres o personas que dicen algo que en realidad no han dicho nunca. En Internet existen cerca de 15.000 vídeos manipulados con técnicas conocidas como deepfake y el 96% son pornográficos y no consentidos por las mujeres que aparecen en ellos. Son solo dos de las conclusiones que aparecen en el informe de la compañía Deeptrace, que ha analizado la proliferación del fenómeno en los últimos años. Los datos del estudio corresponden a los meses de junio y julio de este año, mientras que los ejemplos reflejados fueron recopilados en agosto.

“Los deepfakes están creciendo en Internet rápidamente con un número de vídeos que casi se duplica en los últimos siete meses hasta los 14.678”, comienza el informe. La compañía compara esta cifra con la del año pasado, cuando sumaron en total 7.964 deepfakes circulando por Internet. Entre las razones de la proliferación, esgrimen la “creciente mercantilización de herramientas y servicios que reducen la barrera para los no expertos”.

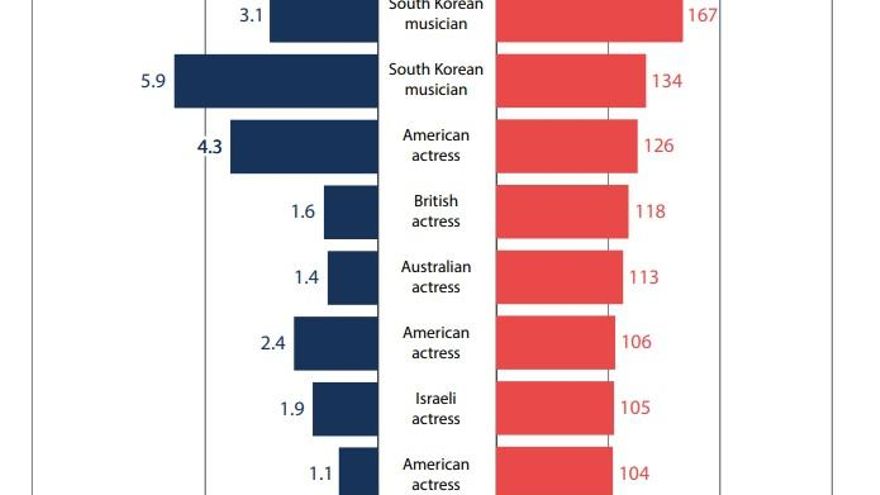

Las manipulaciones de contenido sexual o pornográfico “representan el 96% del total de los deepfakes en Internet”, explican. Sumando las visitas de las cuatro principales webs dedicadas a este tipo de pornografía, cuyos nombres han decidido omitir, los vídeos alcanzaron los 134 millones de reproducciones. Se trata de pornografía no consentida por las mujeres, la mayoría a su vez actrices famosas, cuyo rostro aparece en el vídeo falso.

Todo un negocio en torno a los deepfakes porno

El fenómeno explotó a finales del 2017, más concretamente en diciembre. Un usuario del macroforo de Internet Reddit que se hacía llamar deepfakes estaba subiendo vídeos porno alterados, en los que las actrices mantenían su cuerpo original pero no así su cara: esta, en cambio, era la de famosas de Hollywood y el acabado era bastante real. Ya hablamos de ello en eldiario.es.

Poco después de la polémica, Reddit cerró la cuenta de deepfakes. Para entonces el código ya circulaba libre por Internet, en parte porque fue subido a GitHub (un repositorio de código), en parte porque era jugoso desde el punto de vista tecnológico y fueron muchos los curiosos que se lanzaron a experimentar. Hoy los deepfakes pueblan la Red, desde falsos Baracks Obamas y Donalds Trumps diciendo cosas impensables hasta Jennifer Lawrence con la cara de Steve Buscemi en la gala de los Globos de Oro. Hace poco, hasta El Intermedio se ha subido al carro inaugurando una sección en la que Dani Mateo entrevista al Gran Wyoming, donde a ojos del espectador este mantiene su cuerpo pero no así su cara.

Los investigadores de Deeptrace abundan en el porno con deepfakes: “Es un fenómeno que exclusivamente selecciona y daña a las mujeres”. Más del 70% de las caras falsas que aparecen en los vídeos corresponden a actrices occidentales, mientras que el 25% son surcoreanas y el 3% restante, indias. Prácticamente todos los deepfakes pornográficos están fabricados con personalidades del mundo de la televisión, el cine o el entretenimiento.

El informe divide a las webs porno de Internet en dos categorías: las que se dedican única y exclusivamente a publicar deepfakes de este tipo y las páginas web porno tradicionales, que también albergan cierto contenido aunque en menor porcentaje. “Descubrimos que el ecosistema está casi totalmente apoyado por sitios web dedicados a la pornografía con deepfakes, que albergan 13.254 del total de los vídeos que descubrimos. Por contra, las webs pornográficas convencionales solo alojaban 802 vídeos”, continúan los investigadores.

Deeptrace también señala que los principales sitios desde donde los deepfakes salen al mundo son las webs de Reddit, 4chan, 8chan y Voat. Estima cerca de 20 comunidades en estas páginas dedicadas a la creación del contenido y los cifra en “cerca de 100.000 miembros”. Este dato solo corresponden a 13 de esas 20 comunidades, ya que las siete restantes no quisieron hacer público su número de socios. Los investigadores alertan, además, sobre las numerosas apps y servicios que desde solo 2,99 dólares (2,73 euros) permiten la creación de deepfakes.

Consecuencias políticas de los deepfakes

El informe también recuerda el caso de Deepnude, la app que permitía quitarle la ropa a casi cualquier fotografía en la que apareciese una mujer. Aunque a los pocos días de ser lanzada su creador se arrepintió y la eliminó de Internet, ya era tarde: el código ya estaba en la Red. Hoy, diferentes versiones de la aplicación se pueden encontrar en Internet “con precios que van desde 1 dólar por foto hasta los 20 dólares por un mes de acceso ilimitado”, explican.

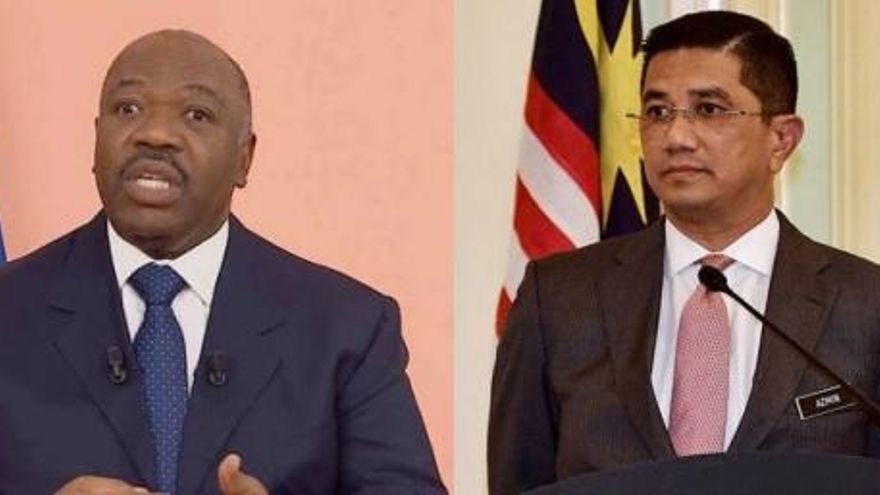

Para terminar, Deeptrace avisa sobre las consecuencias de los deepfakes en la esfera política poniendo dos ejemplos, el del presidente de Gabón Ali Bongo y el del ministro de Economía de Malasia, Azmin Ali.

En el caso del primero, en un intento por detener las crecientes especulaciones sobre su salud y su desaparición de la vida pública, el gobierno publicó a principios de este año un vídeo en el que aparecía Bongo dando el discurso de Año Nuevo. Varios medios de comunicación gaboneses y la oposición denunciaron que se trataba de un deepfake y una semana después de su publicación los militares dieron un golpe de estado fallido. Sin embargo, los análisis forenses no pudieron demostrar que el vídeo era falso. Meses después, el Gobierno reconoció que Bongo había sufrido un derrame cerebral en agosto del 2018.

Por otro lado, en junio del 2019 salió a la luz un vídeo en el que el ministro de Economía de Malasia, Azmin Ali, aparecía manteniendo relaciones sexuales con un ayudante de un ministro rival. Mientras que el ayudante aseguró que el vídeo era real, Ali lo negó asegurando que se trataba de un deepfake. En el país asiático las relaciones homosexuales no están permitidas, por lo que Ali ahora se enfrenta a cargos criminales por las imágenes. A día de hoy, los expertos forenses que analizaron el vídeo sostienen que es real.