Un robot se pone a pelotear con humanos y decide fijarse en sus fallos: así está aprendiendo a jugar al tenis mejor

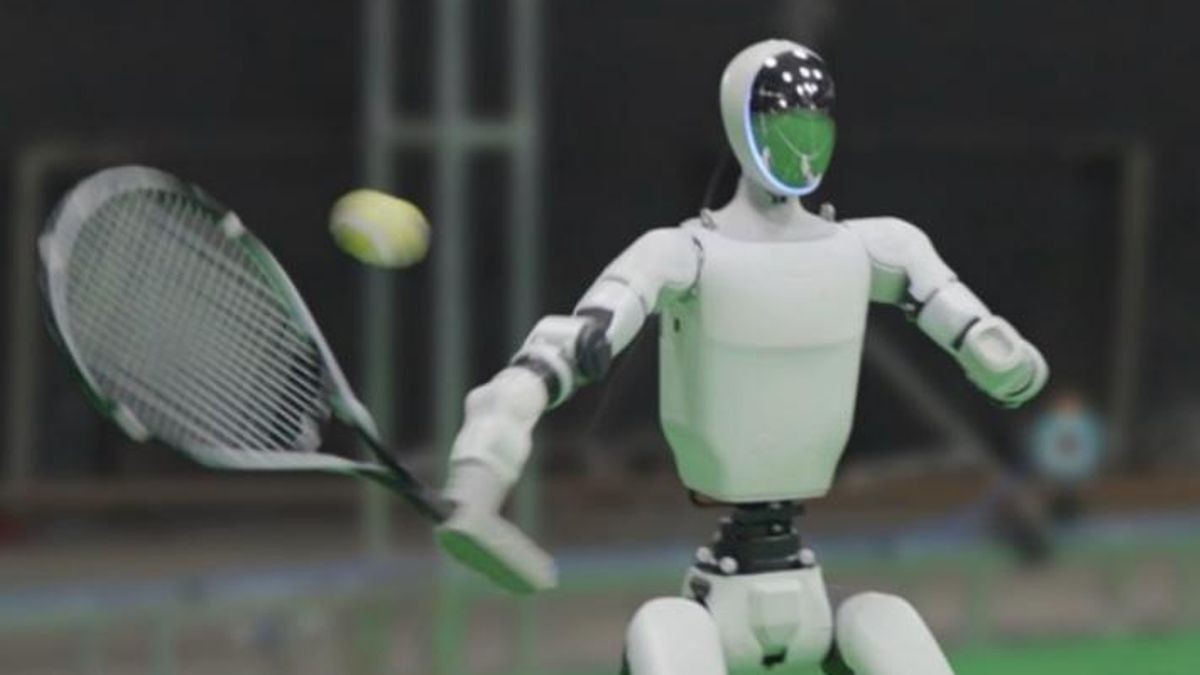

El movimiento de una máquina ya no se percibe rígido ni limitado a gestos torpes. Los robots han ido ganando soltura en sus movimientos y hoy ejecutan acciones que recuerdan cada vez más a las de una persona, aunque siguen lejos del nivel de los grandes atletas.

Esa diferencia se nota en la velocidad de reacción, en la precisión bajo presión y en la capacidad de anticipar jugadas complejas. Aun así, la mejora en la forma de moverse ha cambiado el punto de partida de la robótica aplicada al deporte. Ese avance obliga a encontrar nuevas formas de enseñarles habilidades que antes resultaban imposibles de reproducir.

Un equipo chino presenta un método que enseña tenis sin datos perfectos

Un sistema desarrollado en China llamado LATENT permite que un robot humanoide aprenda a jugar al tenis a partir de datos humanos imperfectos y mejore su rendimiento en distintas situaciones, según TechXplore. El trabajo, publicado en arXiv, muestra que no es necesario contar con registros perfectos para entrenar a una máquina.

El robot puede devolver pelotas, enlazar varios golpes seguidos y moverse con una naturalidad que no era habitual en este campo. Esa mejora se apoya en una forma distinta de entender el aprendizaje, donde los errores y fragmentos incompletos también aportan información útil.

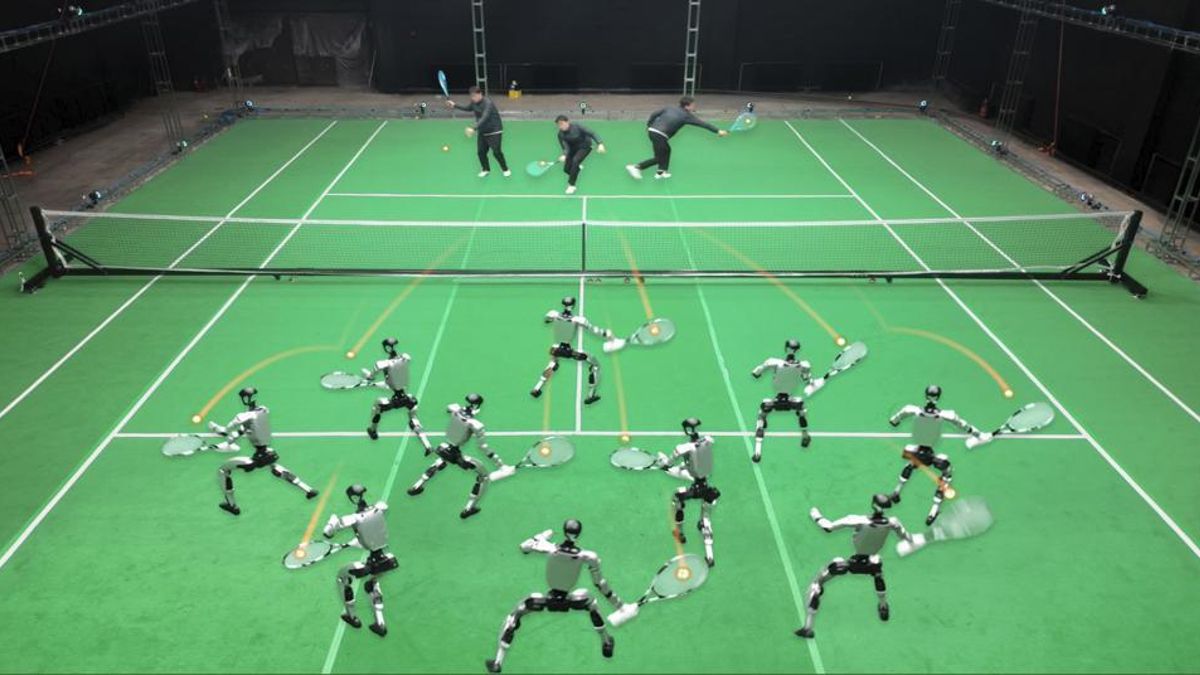

El proceso arranca con la recogida de datos básicos de juego obtenidos de jugadores amateurs. Los investigadores reunieron unas cinco horas de fragmentos de habilidades simples, como golpes de derecha y de revés o desplazamientos laterales. A partir de ese material construyeron un espacio de acciones latentes que representa las posibles respuestas del robot.

Ese sistema permite ajustar y reorganizar los movimientos para adaptarlos a cada situación, en lugar de repetir secuencias cerradas. La estructura facilita que el robot aprenda a encadenar acciones de forma flexible y no como una serie fija de gestos.

Las pruebas en pista demuestran intercambios reales contra personas

Las pruebas en pista muestran cómo ese aprendizaje se traduce en comportamiento real. El robot fue capaz de jugar contra personas y mantener intercambios de varios golpes en distintas zonas de la cancha. Ejecutó golpes de derecha y de revés mientras se adaptaba tanto a posiciones cercanas a la red como al fondo.

Esa capacidad de responder en diferentes posiciones indica que el sistema no se limita a un tipo de jugada, sino que gestiona varias situaciones dentro del mismo entrenamiento. La interacción con humanos, en este sentido, permite evaluar hasta qué punto el movimiento se acerca al de un jugador real.

El uso de datos imperfectos marca la diferencia en este planteamiento. En lugar de depender de capturas completas y exactas del movimiento humano, el sistema trabaja con fragmentos que contienen acciones básicas. Según los investigadores, esos datos, aunque no sean los ideales, aportan información sobre habilidades fundamentales del tenis.

Al reorganizarlos y corregirlos, el robot aprende a responder a pelotas entrantes bajo distintas condiciones y a devolverlas hacia zonas objetivo. Ese método reduce la dificultad de recopilar información y abre la puerta a entrenar en contextos donde no existen registros detallados.

Los resultados se evaluaron con 10.000 pruebas que comparan este sistema con métodos anteriores. El rendimiento mejora en precisión, en porcentaje de éxito y en la naturalidad del movimiento. En su mejor registro, el robot alcanzó un 96,5% de aciertos, medido como la capacidad de devolver la pelota a menos de 2,5 metros del objetivo.

Además, el sistema mantiene peloteos continuos con jugadores humanos, algo que antes resultaba difícil de conseguir. Esa cifra refleja un avance en la capacidad de respuesta, aunque no implica que el robot pueda competir con profesionales.

El modelo actual presenta límites en autonomía y toma de decisiones

A pesar de los avances, el sistema presenta límites claros que los propios investigadores señalan. El funcionamiento actual depende de un sistema de captura de movimiento para operar fuera del laboratorio, lo que reduce su autonomía. También trabaja con un modelo de juego simplificado, centrado en devolver pelotas generadas de forma aleatoria hacia un punto objetivo.

Esa configuración no reproduce un partido completo con decisiones tácticas ni intercambio competitivo real. Los investigadores plantean que la incorporación de visión activa podría mejorar esa situación y permitir una interacción más completa.

El entrenamiento final se apoya en aprendizaje por refuerzo y simulaciones antes de trasladar el modelo al robot Unitree G1. Ese proceso permite que lo aprendido en un entorno controlado funcione en condiciones reales.

La transferencia se realiza con ajustes que introducen variaciones en el entorno y en las percepciones del robot, para evitar que dependa de situaciones idénticas a las simuladas. El resultado es un sistema que mantiene coherencia en su comportamiento cuando pasa del laboratorio a la pista, aunque todavía necesita mejoras para acercarse al nivel de juego humano más exigente.

0